Deutschland will bei der Entwicklung von Generativer Künstlicher Intelligenz vorne mitspielen – und nicht amerikanischen und chinesischen Firmen das Feld überlassen. Die Hoffnungen ruhen dabei vor allem auf einem Start-up aus Heidelberg: Aleph Alpha. Wir erklären, wie die Firma mit Transparenz, einem Fokus auf Unternehmen und Behörden als Kunden und großen Partnern punkten will.

Von Wolfgang Kerler

Den Streit um die Kindergrundsicherung gerade rechtzeitig beigelegt. Das Wachstumschancengesetz doch noch auf den Weg gebracht. Und trotzdem miese Stimmung. Das kam vergangene bei der Klausurtagung der Bundesregierung herum. Zumindest vermittelte die Berichterstattung diesen Eindruck.

Dabei beschäftigten sich Kanzler Scholz, Vizekanzler Habeck, Finanzminister Lindner und die anderen Regierenden auch mit Künstlicher Intelligenz. Wie kann Deutschland vom KI-Boom profitieren? Was brauchen heimische KI-Firmen? Wie kann KI bei der Digitalisierung des Staates helfen? Um Antworten zu bekommen, bestellte das Kabinett drei Expertinnen und Experten ins Schloss Meseberg ein. Einer davon: Jonas Andrulis, der Chef des Heidelberger Start-ups Aleph Alpha.

Dem Bundeskanzler Künstliche Intelligenz erklären. Wer kann das von sich behaupten? Doch für Jonas Andrulis dürften solche Termine fast alltäglich sein. Am Tag vor der Kabinettsklausur verkündete Aleph Alpha, dass es sich am KI-Innovationspark in Heilbronn beteiligen werde. Zum Pressetermin reisten extra Baden-Württembergs Ministerpräsident Kretschmann und der Bundesverkehrsminister an.

Der Hoffnungsträger der Politik

Kein Zweifel, die Politik hofiert Aleph Alpha – wegen ChatGPT. Der Erfolg des KI-Chatbots schreckte Entscheidungsträger in Bundesländern, im Bund und bei der EU in Brüssel auf. Ihnen wurde klar, welche Fortschritte KI gemacht hatte und was für ein Riesengeschäft sie werden könnte. Doch OpenAI, die Firma hinter ChatGPT, stammte einmal mehr aus dem Silicon Valley. Jetzt soll vermieden werden, dass KI zum nächsten Internet wird. Das wird von amerikanischen und chinesischen Konzernen dominiert – und die Europäische Union muss sich damit begnügen, sie zu regulieren.

Bei KI stehen die Chancen an sich nicht schlecht: Bei Forschung und Lehre ist die EU Weltspitze. Nicht ohne Grund arbeiten selbst bei OpenAI viele in Europa ausgebildete Talente. Auch wurde der erfolgreiche Open-Source-Bildgenerator Stable Diffusion von einer Forschungsgruppe der Universität München entwickelt. Doch erfolgreiche Wissenschaft garantiert keinen kommerziellen Erfolg. Es braucht also Start-ups, die aus Forschung Umsatz und Arbeitsplätze machen.

Wird angesichts dessen nach Europas Antwort auf OpenAI gefragt, werden – wie das US-Techmagazin WIRED gerade feststellte – im Grunde nur zwei Firmen genannt: Mistral aus Frankreich, das allerdings noch kein Produkt auf dem Markt hat. Und Aleph Alpha aus Deutschland.

Genau wie OpenAI entwickelt Aleph Alpha unter dem Namen Luminous sogenannte Large Language Models, also KI-Modelle, die Sprache verstehen und erzeugen können. Bei Vergleichstests im Frühjahr konnte Luminous mit GPT-3 von OpenAI und einer Meta-KI mithalten. Auch mit Bildern kann Luminous umgehen und deren Inhalt analysieren und beschreiben. Das klingt erstmal nach direkter Konkurrenz für OpenAI. Doch Aleph Alpha strebt nicht nach Hunderten Millionen Userinnen und Usern, wie sie täglich ChatGPT nutzen.

„Wir fokussieren uns nicht darauf, für eure Kinder die Hausaufgaben zu erledigen“, sagt Jonas Andrulis im Juli beim Festival der Zukunft von 1E9 und Deutschem Museum. Produkte für Privatanwender, also das klassische B2C-Geschäft, interessierte Aleph Alpha nur am Rande. Denn seine Kundschaft sieht das Start-up in Behörden, Ministerien und Unternehmen, die KI für interne Chatbots, die Auswertung von Datenbanken oder auch die Zusammenfassung von Dokumenten einsetzen wollen. Und denen Datenschutz, Transparenz und Erklärbarkeit von KI wichtig sind – und die deshalb lieber auf einen europäischen Anbieter setzen.

Das Alleinstellungsmerkmal: Transparenz und Erklärbarkeit

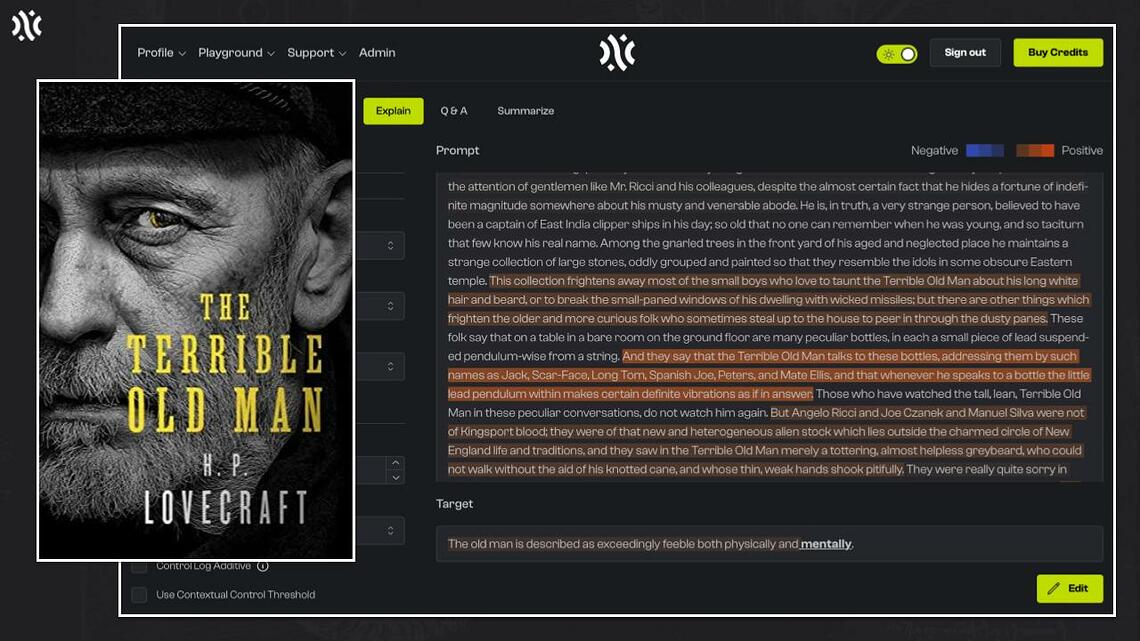

Aleph Alpha will vor allem mit KI, der man vertrauen kann, gegenüber der Konkurrenz punkten. Im April bekam Luminous daher ein neues Feature verpasst. Seitdem soll es nicht nur möglich zu sein, der KI vorzugeben, dass sie nur auf Basis bestimmter und verifizierter Datensätze antworten soll. Sie kann außerdem ihre Ergebnisse erklären, indem sie für jedes Wort ihrer Antwort angeben kann, welcher Inhalt des Prompts für dessen Erstellung verantwortlich war.

Beim Festival der Zukunft demonstriert Jonas Andrulis das an einem Beispiel: Der Prompt enthält die Kurzgeschichte The Terrible Old Man von H.P. Lovecraft. Die KI wird außerdem gefragt, wie der alte Mann, um den es darin geht, charakterisiert wird. Die Antwort: „The terrible old man is described as exceedingly feeble, physically and mentally”. Er sei also sehr schwach, körperlich und geistig. Doch wie kommt Luminous darauf?

Klickt man auf das Wort „mentally“, markiert die Software mehrere Sätze in der anfangs geprompteten Kurzgeschichte farbig. Je kräftiger der Farbton, umso mehr deutete der jeweilige Satz auf die geistige Schwäche des Mannes hin. In diesem Fall war das recht eindeutig, keiner der Sätze sprach gegen diese Feststellung. Doch Jonas Andrulis zeigt ein weiteres Beispiel, bei dem die KI zusätzlich die Inhalte des Prompts markiert, die gegen die von ihr gegebene Antwort standen. Dadurch soll deutlich werden, dass die KI keine eindeutigen Ergebnisse liefert, sondern auf Basis von Wahrscheinlichkeiten abwägt.

„So kann ein Mensch viel schneller und einfacher die Ergebnisse des Modells bewerten“, erklärt Jonas Andrulis. „Die natürlich auch weiterhin falsch sein können.“ Sprich: Menschen sollen leichter feststellen können, ob die KI faktische Fehler produziert oder gar halluziniert hat. Das neue Feature funktioniere außerdem nicht nur mit Texten als Input beziehungsweise Prompts, sondern auch mit Bildern, die von der KI beschrieben oder analysiert werden sollen. In so einem Fall werden die Bereiche im Bild markiert, die für oder gegen ihre Antwort sprachen.

Das allein reicht aus Sicht von Jonas Andrulis aber noch nicht, um alle KI-Ergebnisse nachvollziehbar zu machen. In manchen Fällen brauche es mehr Kontext, zum Beispiel, wenn ein Foto, das zwei Kinder zeigt, die vor dem Weihnachtsbaum einen Computer auspacken. Wieso wird es von Luminous als „Christmas Morning in the 80’s“ beschrieben, als Weihnachten in den 80ern?

Das einfache Markieren der relevanten Bildbereiche reicht nicht aus, um zu erklären, wie die KI auf die 80er kam. Denn es fehlt die Info, dass die Software den Computer als Commodore 64 identifiziert hat, der in den 80ern gebaut wurde. Aleph Alpha arbeitet bereits daran, solche ausführlicheren Erklärungen möglich zu machen. Es gehe darum, „KI-Systeme so zu trainieren, dass sie Unsicherheiten artikulieren, Rückfragen stellen und uns wie gute Lehrer ihre Überlegungen erklären“, sagt Jonas Andrulis.

Große Partner und frisches Geld, um mit der US-Konkurrenz mitzuhalten

Aleph Alpha setzt darauf, dass sich Behörden und Ministerien, aber auch Industrieunternehmen oder Firmen in sensiblen Märkten wie Gesundheit oder Finanzen mit KI wohler fühlen, die aus Europa stammt und deren Ergebnisse nachvollziehbar sind. Bisherige Partnerschaften scheinen diesen Bedarf zu bestätigen.

Im August gab Bosch bekannt, dass bis Jahresende ein interner KI-Chatbot starten wird. Er soll Stichwortsuchen in Datenbanken ersetzen, die bisher oft ins Leere laufen, wenn man nicht genau weiß, wonach man sucht. Entwickelt wird „BoschGPT“ mit Aleph Alpha. Die Landesverwaltung von Baden-Württemberg nutzt mit F13 schon seit Monaten einen eigenen KI-Assistenten, der das Erledigen typischer Verwaltungsakte beschleunigen soll und ebenfalls mit Aleph Alpha gebaut wurde. Allein bei der ersten Schulung nahmen über 400 Beschäftigte teil. Insgesamt hat Aleph Alpha nach eigenen Angaben bereits 10.000 Kunden.

Für die Weiterentwicklung seiner Technologie, für den Vertrieb – und nicht zuletzt für die nächsten Finanzierungsrunden – kooperiert Aleph Alpha außerdem mit Konzernen wie dem Softwareentwickler SAP, dem Chiphersteller Intel oder Hewlett Packard Enterprise, ein Cloudanbieter, der Rechenzentren mit Supercomputern betreibt. Alle haben gemeinsam, dass sie bei KI nicht von Google, Microsoft oder Nvidia abgehängt werden wollen. Wobei auch Nvidia selbst, immerhin führend bei speziellen Grafikchips für KI, laut einem Bericht des Handelsblatts als Investor bei Aleph Alpha einsteigen will.

Bisher bekam Aleph Alpha mit seinen rund 50 Mitarbeitern von Geldgebern 28 Millionen Euro. Kein Vergleich zu den 1,3 Milliarden Dollar oder 450 Millionen Dollar, die amerikanische KI-Start-ups wie Inflection AI oder Anthropic erhielten, oder gar zum 10-Milliarden-Dollar-Investment von Microsoft in OpenAI. Doch Aleph Alpha schließt auf. Dem Handelsblatt zufolge ist die Firma dabei, von Intel, SAP, Nvidia und Wagniskapitalfonds mehr als 100 Millionen Euro einzusammeln. Die Bewertung der Heidelberger Firma würde damit auf 450 Millionen Euro steigen.

Mehr Training mit besseren Daten

Aber warum brauchen KI-Firmen überhaupt so große Investments? Eine Rolle dabei spielt, dass der Einsatz und die Entwicklung ihrer KI-Modelle so viel Rechenleistung brauchen – entweder von Cloud-Betreibern oder aus eigenen Rechenzentren, wie Aleph Alpha eines in der Region Bayreuth hat. Das Training immer leistungsfähigerer KIs braucht dabei immer leistungsfähigere Hardware. Und ohne weiteres Training wird es die Branche schwer haben. Denn perfekt sind die Künstlichen Intelligenzen lange nicht.

Nicht nur erfinden sie immer wieder falsche Antworten, was nicht nur für ChatGPT oder Bing belegt ist, sondern auch für Luminous-Anwendungen wie den Chatbot Lumi der Heidelberger Stadtverwaltung. Die KIs scheitern außerdem an Aufgaben, die Logik erfordern – zum Beispiel in Form einfacher mathematischer Textaufgaben, wie man sie aus der Schule kennt. Und es gelingt ihnen nicht immer, „Gelerntes“ auf Themen oder Fragestellungen zu übertragen, die in ihren Trainingsdaten nicht vorkamen.

Werde Mitglied von 1E9!

Hier geht’s um Technologien und Ideen, mit denen wir die Welt besser machen können. Du unterstützt konstruktiven Journalismus statt Streit und Probleme! Als 1E9-Mitglied bekommst du frühen Zugriff auf unsere Inhalte, exklusive Newsletter, Workshops und Events. Vor allem aber wirst du Teil einer Community von Zukunftsoptimisten, die viel voneinander lernen.

Jetzt Mitglied werden!

Doch können immer größere, mit immer mehr und besseren Daten trainierte KI-Modelle diese Probleme beseitigen, wenn sie im Grundsatz weiterhin so funktionieren wie GPT-4, Luminous oder LLaMA? Die aktuellen KIs werden schließlich immer wieder als „stochastische Papageien“ kritisiert, die zwar Mustererkennung und Statistik beherrschen, aber keine Ahnung von der Welt haben. Jonas Andrulis hält das für möglich.

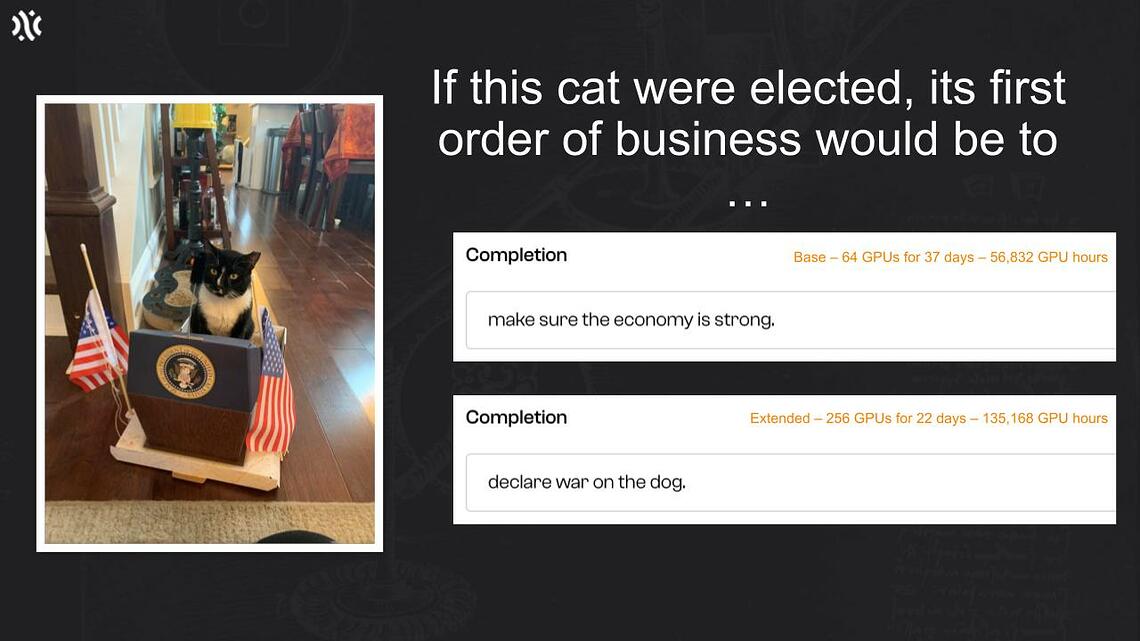

Beim Festival der Zukunft zeigt er ein Beispiel dafür: Einem kleinen KI-Modell von Aleph Alpha – trainiert auf 64 GPUs, also Grafikprozessoren – und einem großen KI-Modell – trainiert auf 256 GPUs –, wurde als Input dasselbe Bild gezeigt: eine Katze, die hinter der Minitaturversion des Rednerpults der US-Präsidenten sitzt, eingerahmt von amerikanischen Flaggen. Beide KIs bekamen die Aufgabe, den Satz zu vervollständigen, was die Katze nach ihrer Wahl zuerst beschließen würde. Das kleine Modell meinte: „Sicherstellen, dass die Wirtschaft stark ist.“ Es hatte offenbar keine Ahnung davon, was Katzen wichtig ist. Anders beim großen Modell. Seine Antwort: „Den Hunden den Krieg erklären.“

„Mit zusätzlicher Größe [der KI-Modelle] erhalten wir vielleicht auch zusätzliche Fähigkeiten wie humorvolle Inhalte zu verstehen oder Hintergrundwissen über Katzen zu verstehen“, schließt Jonas Andrulis daraus. Er zeigt außerdem Forschungsergebnisse, die Belegen sollen, dass KI durch das reine Beobachten von Trainingsdaten eine Art Weltmodell entwickeln kann. Damit kann sie logische Aufgabe lösen oder Spiele gewinnen. Die „stochastischen Papageien“ könnten also doch künstlich-intelligent genug werden, um Ergebnisse hervorzubringen, die vermeintlich echtes Denken erfordern. Das legt zumindest die Keynote von Jonas Andrulis nahe.

Um die Grenzen und Schwächen heutiger KI-Systeme ging es womöglich auch bei den Gesprächen mit dem SPD-Bundeskanzler und seinem Kabinett in Schloss Meseberg. Vielleicht sogar um das Problem, dass KI-Chatbots politisch voreingenommen sind. Und auch das betrifft nicht nur die KIs von OpenAI oder Google, sondern auch die von Aleph Alpha. Dafür spricht jedenfalls ein Post bei X (bzw. Twitter), der den Screenshot einer Aufgabenstellung an Luminous enthält. Sollte dieser echt sein, würde die KI von Aleph Alpha ihre Stimme kaum Olaf Scholz geben. Denn sie hält die CDU für „die Partei der Zukunft“ und „die Partei der Familie, der Heimat und des Vaterlandes“.

Titelbild: Jonas Andrulis beim Festival der Zukunft, Sebastian Huber für 1E9

Hat dir der Artikel gefallen? Dann freuen wir uns über deine Unterstützung! Werde Mitglied bei 1E9 oder folge uns bei Twitter, Facebook, Instagram oder LinkedIn und verbreite unsere Inhalte weiter. Danke!

Sprich mit Job, dem Bot!

War der Artikel hilfreich für dich? Hast du noch Fragen oder Anmerkungen? Ich freue mich, wenn du mir Feedback gibst!