Künstliche Intelligenzen sind nicht intelligent und denken können sie auch nicht. Aber ein Vorstellungsvermögen besitzen sie schon. Könnte man jedenfalls meinen. Denn sie verfügen über die Fähigkeit, in den pixeligen Gesichtern von Videospielhelden echte Menschen auszumachen – und sie uns zu zeigen.

Von Michael Förtsch

Eine Hand voll Pixel, ein paar grobe Polygone, eine Textur, die dem Blick durch eine Milchglasscheibe gleicht. Über viele Jahre war es das und nicht mehr, was die Helden in unseren Lieblingsvideospielen ausmachte. Trotzdem wussten wir ganz genau, wie sie aussehen. Unsere Vorstellungskraft ergänzte all das, was auf dem Bildschirm und Fernseher fehlte. Sie verwandelte einzelne Pixel und Polygone in Augen, Münder, Nasen und wallende Haare. Dadurch hatte jeder eine sehr persönliche Interpretation, wie Lara Croft, der Doom Guy oder auch Solid Snake im „echten Leben“ aussehen würden.

Es waren Vorstellungen, die gerne mal wenig mit dem zu schaffen hatten, was die Entwickler im Sinn und auf der Spielepackung oder in Zwischensequenzen abgebildet hatten. Nun, mittlerweile sind wir Menschen aber nicht mehr die Einzigen, die eine Vorstellungskraft besitzen, denn wir leben im Zeitalter der Künstlichen Intelligenzen und denkenden Maschinen, die bald schon die Weltherrschaft an sich reißen werden. Okay, nein, Spaß beiseite. Denn eine Künstliche Intelligenz ist – zumindest bislang – weder intelligent noch kann sie denken. Aber … eine Vorstellungskraft, doch, die könnte man ihr schon in gewisser Weise unterstellen. Irgendwie jedenfalls.

Künstliche neuronale Netze können aus Datenbergen lernen, statistische Zusammenhänge ausfiltern, Muster erkennen und Korrelationen ableiten – und dadurch anschließend auch selbstständig Dinge neu erschaffen. Anfang 2019 verblüffte die Website thispersondoesnotexist.com viele Menschen. Mit jedem Besuch, jedem Reload erscheint dort ein neues Foto einer Person. Jedoch gehören die Gesichter zu Menschen, die es nicht gibt. Der KI-Forscher Phillip Wang hat die Internetseite entwickelt und mit einem StyleGAN verknüpft. Das ist ein System aus zwei neuronalen Netzen, das mit unzähligen Bildern von Menschen trainiert worden war.

Wenn das generierte Bild heruntergerechnet mit dem niedrig aufgelösten Original identisch ist, tja, das folgert das KI-System, müsste das hochaufgelöste StyleGAN-Foto eigentlich so aussehen wie das niedrig aufgelöste Original in groß aussah.

Eines der Netze versucht, diese Bilder nachzuahmen; mehr Bilder dieser Art mit den gelernten Mustern zu erzeugen. Das andere Netz versucht, Makel in den generierten Fotos zu finden. Dadurch werden die Fake-Gesichter mit jedem Bild besser und besser – zumindest theoretisch. Aber diese Künstlichen Intelligenzen können nicht nur Gesichter aus dem Blauen herauf fantasieren. Sie können, fast wie ein Mensch, auch in einem vagen Pixelbrei ganze Gesichter entdecken – und auf den Schirm bringen.

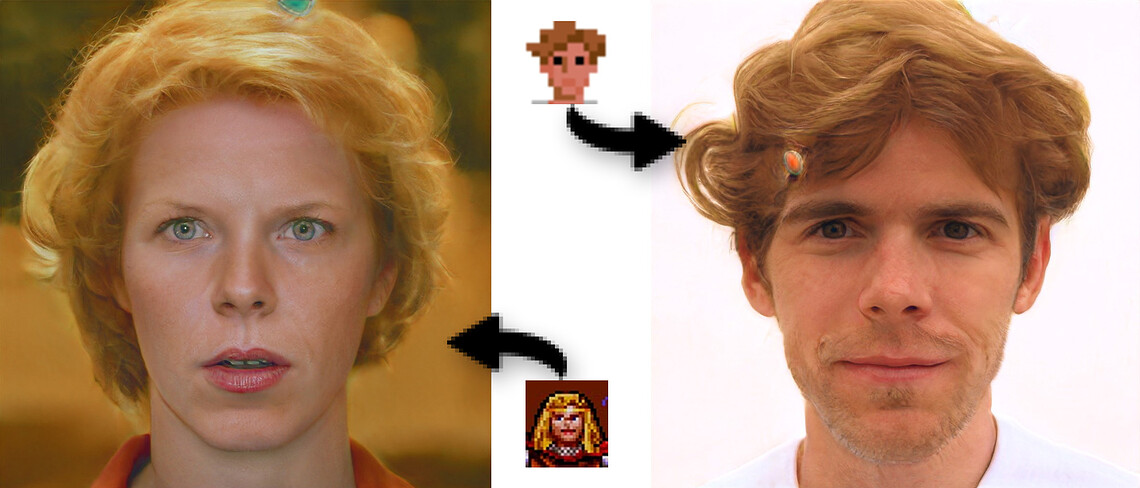

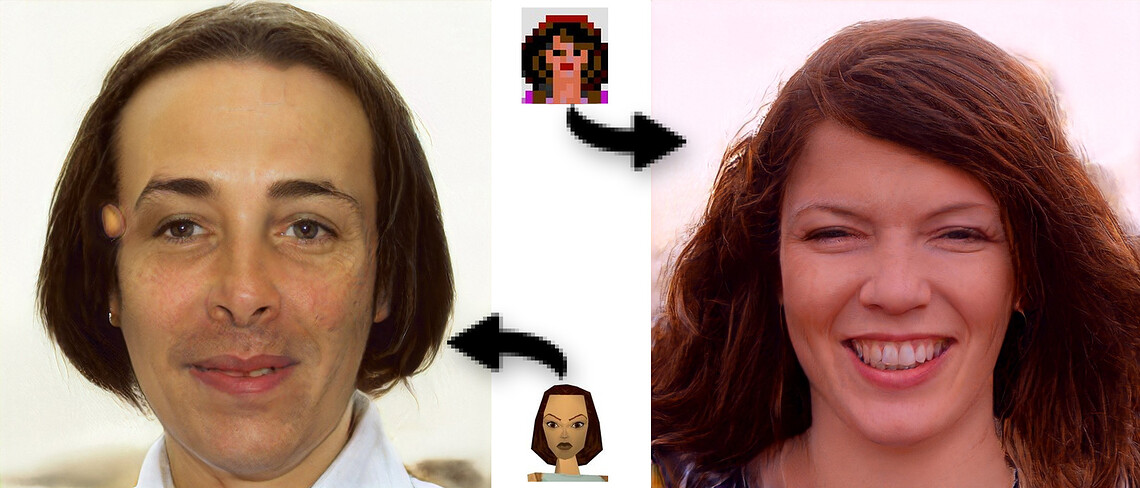

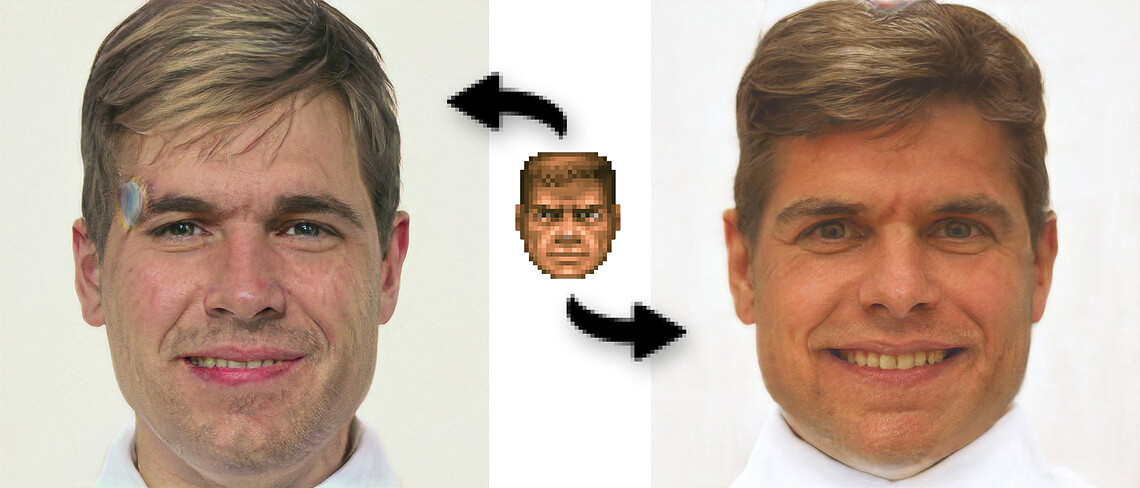

Das geht etwa mit einem System, das den eleganten Namen Self-Supervised Photo Upsampling via Latent Space Exploration of Generative Models trägt. Oder, etwas kürzer: PULSE. Diese Künstliche Intelligenz wurde entwickelt, um aus niedrig aufgelösten Gesichtern hochaufgelöste Porträts zu machen. Das tut sie auf eine ganz besondere Weise. Sie schaut sich das Pixelgesicht an, um dann mit einem StyleGAN-System ein Gesicht zu generieren. Das verkleinert sie dann auf die Größe des Pixelgesichtes. Sie vergleicht, wie nahe sich beide kommen und generiert dann ein weiteres Gesicht, das wieder verkleinert und mit dem niedrig aufgelösten Original verglichen wird. Und das wieder und wieder, so dass sich die beiden immer mehr annähern – bis sie identisch sind.

Wenn das generierte Bild heruntergerechnet mit dem niedrig aufgelösten Original identisch ist, tja, das folgert das KI-System, müsste das hochaufgelöste StyleGAN-Foto eigentlich so aussehen wie das niedrig aufgelöste Original in groß aussah. Oder, nein, zumindest könnte es mit hoher Wahrscheinlichkeit so ausgesehen haben. Und das ist close enough.

Entwickelt und getestet wurde PULSE von seinen Machern an der Duke University natürlich nicht mit Videospielcharakteren im Kopf. Sie nutzten ein sogenanntes Dataset mit unzähligen Bildern von Prominenten, die für KI-Experimente zusammengestellt wurden. Und wie die Forscher selbst sagen, kommt das generierte Bild den Originalen manchmal recht nahe. Manchmal aber auch gar nicht. Die Entwickler selbst sprechen daher bei den Bildern von Halluzinationen. Einen praktischen Zweck hat das System auch bisher nicht. Es ging eher um die Technologie, Machbarkeit und Sichtbarmachung von Limitierungen und biases derartiger Methoden.

Verstehe, was die Zukunft bringt!

Als Mitglied von 1E9 bekommst Du unabhängigen, zukunftsgerichteten Tech-Journalismus, der für und mit einer Community aus Idealisten, Gründerinnen, Nerds, Wissenschaftlerinnen und Kreativen entsteht. Außerdem erhältst Du vollen Zugang zur 1E9-Community, exklusive Newsletter und kannst bei 1E9-Events dabei sein. Schon ab 2,50 Euro im Monat!

Jetzt Mitglied werden!

Dennoch sind die Ergebnisse beeindruckend und nötigten mich dazu, die Künstliche Intelligenz auf pixelige oder verschwommene Videospielhelden loszulassen. Etwas, das recht einfach geht, wenn man sich etwas mit Python herumschlägt und das Spiel mit Optimizern und Lernraten-, Epsilon- und Seed-Werten nicht scheut. Herausgekommen sind dabei zuweilen Gesichter, die meine Vorstellung der Helden untermauerten. Manche Ergebnisse hingegen gleichen tatsächlich bizarren Halluzinationen und psychedelischen Albtraummenschen. Und manche, die waren einfach nur noch zum Lachen.

Hat dir der Artikel gefallen? Dann freuen wir uns über deine Unterstützung! Werde Mitglied bei 1E9 oder folge uns bei Twitter, Facebook oder LinkedIn und verbreite unsere Inhalte weiter. Danke!

Dieser Text unseres Redakteurs Michael Förtsch erschien zuerst im Games-Kultur-Bookazine WASD . Dort könnt ihr auch weitere Bilder finden.